细思极恐!超百部“明星、网红换脸”色情视频仅售几十元,揭秘幕后→

7月3日,一名拥有670余万粉丝的网红女主播陈岚发布视频称,她遭遇了恶意Ps和AI换脸,照片被人做成了色情照片和视频,并在网上公开出售。

陈岚说,她本想搜集相关证据,找出根源,又不想太声张,但随着评论区越来越多人“造谣”,她打算报警。

近日,记者调查发现,不少账号在社交平台出售明星、网红换脸的色情照片和视频, 超百部视频售价仅几十元。

卖家出售换脸的色情素材主要分为两种模式, 一种是利用明星的公开照片“去衣”;另一种是把明星的脸换到色情图片和视频中。

在多个电商平台,不少商家在线出售AI绘图软件,并号称此类软件可以提供“去衣”功能,该软件售价仅十几元。

实际上,“AI换脸”不仅能制作色情照片和视频,可能还被人用来诈骗。6月25日,全国人大常委会法制工作委员会举行记者会,发言人臧铁伟表示,利用“AI换脸”技术实施诈骗是一种新型的电信网络诈骗,需要广大群众提高识骗防骗意识,也需要有关部门依法加强治理和执法,追究相关人员法律责任。

换脸的色情视频

被公开叫卖

除女主播陈岚外,拥有400多万粉丝的网红女主播杜悦也遇到类似情况。

据杜悦介绍,半年前,很多粉丝在她短视频的评论区留言,说他们都看过杜悦的“色情视频”。

“当时没多想,我认为清者自清,毕竟这个‘谣言’总会过去。”杜悦说,直到有天她的一位朋友转来一段色情视频,女主角正是自己的模样,她才意识到遭遇了恶意“换脸”。

杜悦说,为证明自己清白,她开始搜集相关证据,想找到根源。“最后我发现有人在境外社交平台上冒用身份注册了账号,然后‘搬运’到国内视频平台上发布,等到账号有一定粉丝后,就开始售卖换脸后的色情视频。”

杜悦提供的一张价格表显示,里面涉及数百名网红,还按照粉丝量级做了区分, 从50万粉丝以下到1000万粉丝以上,对应的换脸色情视频售价在30元到50元不等。

此外,表格中还有众多女明星。该表格的发布者称, “200元可以进群,进群后私人定制,永久半价。”

记者调查发现,在一些社交平台上,很多账号宣称自己可出售网红和明星的换

脸色情素材,通过这种方式引流到QQ上进行交易。

按照杜悦提供的线索,记者添加了一名卖家的QQ好友,对方直接发来一张截图,图片上贴有几十位女明星色情图片。

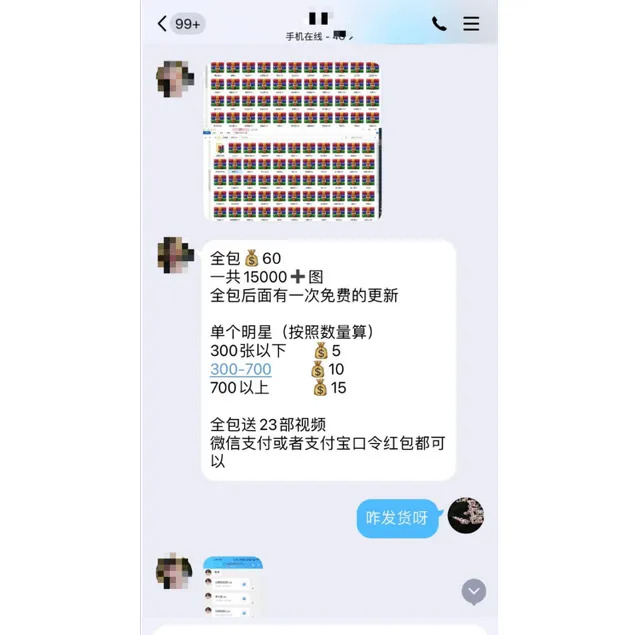

该卖家称,自己拥有80多位明星、一万五千余张图片。如果全部购买,仅售价60元,还赠送23部视频,此后还能享受一次免费更新。卖家还称,如果购买单个明星的换脸图片,则根据照片的数量收费,5元钱能购买300张照片。

来百度APP畅享高清图片

有卖家称60元可购买多位明星的换脸色情素材(记者截图)

此外,还有卖家表示,根据买家需求,他可以专门制作指定某位明星和网红的色情素材。

支付60元后,一名卖家发来数十个压缩包,均以明星姓名命名。记者发现,该卖家出售的变脸色情素材主要分为两种模式,一种是利用明星的公开照片“去衣”,另一种则是将这些明星的脸换到色情图片和视频中。

北京蓝鹏律师事务所主任张起淮曾代理多起“AI换脸”相关案件。在他看来, “AI换脸”本应是帮助广告、电影、艺术等方面进行适当修复,这本是一项很好的技术,但现在很多人开始利用这一技术进行非法牟利。

张起淮表示, 利用他人的肖像进行换脸,涉嫌侵犯当事人的肖像权、名誉权、荣誉权和人格权。如果将当事人的脸制作成色情视频并出售,这种情况下可能构成刑事犯罪。

“AI绘图软件”

仅需16.66元

月销量超200

近日,记者在多个电商平台上搜索“AI换脸”关键词,均已无法显示。但是,记者搜索“智能合成、明星”“真人脸部模型训练”“去衣AI”等关键词,仍旧可以搜到在售商品。

一款“AI绘图软件”的产品页明确标注,“该软件可实现真人转卡通功能、换头和换衣功能”。这款软件售价仅需16.66元,月销量达到200以上。

“可以真实‘去衣’?”有人在该店铺评论区提出疑问,多人回复称可以。此外,有人还询问是否能生产色情图片,有人回复称,“只要购买软件进入买家交流群即可,什么功能都有。”

在某AI绘图软件的问答区,有人回复称该软件确有“去衣”功能。(记者截图)

记者进入“买家交流群”后,仅两天时间,群成员便从40人迅速增长至150人,大多成员在群内交流该软件如何使用,还不时分享自己的“作品”。

有成员在群里询问,是否有人愿意接单,制作“定制图”。 “这玩意不是犯法吗?”有人在群里反问,对方则表示“富贵险中求”。

除了出售绘图软件,还有商家提供“真人模型代训练”,这是利用真人的照片或视频生产,训练结束后,便可以直接利用该模型生成对应的照片和视频,达到换脸效果。

一名提供代训练服务的商家告诉记者,只需提供20至30张照片,尽量以脸部特写为主,2个多小时便可完成训练。然后,买家将数据导入某软件内,便可以生成想要的素材。

该商家向记者发来一张效果图,这是利用国内一名模特真实照片生产的效果图,经过换脸后,脸部和国内某明星相似度极高。

上述商家表示,在模型训练完成后,买家可以根据自己诉求生成各种照片,包括“去衣”素材,但云端禁止“去衣”操作,需要自己在电脑上操作才行。

揭秘“AI换脸”骗局

商家售卖“作案工具”的背后,还有人利用“AI换脸”技术进行诈骗。

张起淮告诉记者,他曾经代理过多起发生在缅北的跨国敲诈勒索案。这个案件中的犯罪嫌疑人便是利用“AI换脸”技术,伪装成女性,诱导受害人与其“裸聊”。随后便以双方的视频录屏内容为证据,对受害人进行敲诈勒索。

近日,中国银河证券发布公告称: 利用“AI合成技术”的诈骗手段或将逐步影响至证券行业。

公告显示,某知名经济学家称,自己被人利用“AI换脸”等技术,通过视频、语音等方式联系投资者,骗取投资者信任,开展荐股活动。

此前,多地警方通报有关“AI换脸”的诈骗案件。5月20日,包头市警方发布了一则使用AI换脸的电信诈骗案例。当事人郭先生此前突然接到好友的微信视频,好友告诉郭先生,他有个朋友在外地投标需要430万元保证金,想借用郭先生的公司账户过账。郭先生觉得自己和好友开过视频,确认了是本人,便没有多想,直接向对应账户转账过去了。十分钟之内,因为一段视频通话,郭先生便被骗走了430万元。

2022年2月,陈先生报案称,自己被“好友”诈骗了近5万元。经警方核实,诈骗分子利用陈先生好友“阿诚”在社交平台发布的视频,截取其面部视频画面后再利用“AI换脸”技术合成,制造陈先生与“好友”视频聊天的假象骗取其信任,从而实施诈骗。

立法机关正建立健全

相关法律制度

随着人工智能的发展,“AI换脸”技术门槛逐渐降低,应用场景越来越多,在满足人们猎奇、美颜、社交等需求的同时,为了牟利,一些不法分子突破道德底线和法治红线。

为遏制“AI换脸”乱象,2022年11月25日,国家互联网信息办公室、工业和信息化部、公安部联合发布的《互联网信息服务深度合成管理规定》第十七条要求,深度合成服务提供者提供智能对话、合成人声、人脸生成、人脸替换等深度合成服务,可能导致公众混淆或者误认的,应当在生成或者编辑的信息内容的合理位置、区域进行显著标识,向公众提示深度合成情况。

张起淮表示,现在很多犯罪分子开始使用“AI换脸”技术进行犯罪,由于立法总是滞后于社会现象,此类案件的司法实践中大家很难掌握法律标准,所以尽快完善相关立法非常有必要。

张起淮称,针对“AI换脸”技术要加强技术上的监管和鉴别,加强对相关技术的普及。如果遭遇了类似情况的侵权,要在可能的情况下,及时报案或起诉,不能因为怕麻烦,纵容此类现象发生。

臧铁伟表示,当前,中央宣传部、公安部正在全国开展“全民反诈在行动”集中宣传月活动,将进一步贯彻落实反电信网络诈骗法,不断提升群众防骗意识,切实营造全社会反诈浓厚氛围。立法机关也在加强对人工智能等领域法律问题的研究,不断建立健全相关法律制度。

中国政法大学传播法研究中心副主任朱巍表示, 对AI技术的监管重点,

首先, 内容的生产者要为结果负责。

其次, 在使用AI技术的过程中需要告知用户。

如果有人遭遇他人的恶意换脸行为,即使尚未找到这个恶意换脸的人,但提供了换脸这项技术的平台也需要担责, 因为平台本身也有监管用户使用何种素材的责任和义务。

(文中陈岚、杜悦均为化名)